Text von Charlotte Axelsson

Ich mag Wetter-Apps. Oder wie meine Kollegin an der ZHdK, Mela Kocher, gerne zu sagen pflegt: die faszinierendste Glaskugel, in die wir täglich schauen.

Und dennoch ist es – auch an mir – immer wieder lustig zu beobachten, wie überrascht wir sind, wenn nach 26 Grad und heiterem Sonnenschein am nächsten Tag plötzlich ein Drop-down auf 18 Grad und Gewitter kommt. Es ist schwer vorzustellen, aber es kommt trotzdem.

Das ist jetzt vielleicht ein hinkender Vergleich und ein sehr hoher Bogen, den ich spanne. Aber er zeigt zwei Dinge: Zukunft, ob nah oder fern, ist schwer vorstellbar – auch wenn es gute Anzeichen dafür gibt, dass etwas eintreten wird. Und zweitens zeigt er etwas über unser Mindset im Umgang mit Veränderung. Obwohl es für die leichten Sandalen und den Jupe dann wirklich zu kalt ist, ziehen wir es manchmal trotzdem durch.

Vielleicht ist genau das der Punkt: Zukunft ist selten komplett überraschend und selten komplett planbar. Sie liegt irgendwo dazwischen – zwischen Anzeichen, Mustern, Entscheidungen und unserer Fähigkeit, anders zu reagieren, als wir es gestern getan hätten.

Der Affe im Titel bezieht sich auf das Infinite-Monkey-Theorem: Wenn ein Affe unendlich lange zufällig auf einer Schreibmaschine tippt, entsteht irgendwann vielleicht auch Shakespeare. So ähnlich ist es mit Zukunftsprognosen: Manchmal liegt jemand richtig – aber nicht, weil die Zukunft wirklich vorhersehbar wäre. Sondern weil Wahrscheinlichkeit, Muster und Zufall zusammenspielen.

Zukunftsarbeit bedeutet deshalb nicht, richtig zu raten. Sie bedeutet, besser vorbereitet zu sein.

Es ist deshalb vielleicht nicht verwunderlich, dass gerade so viele Formate rund um Future Mindset, Future Skills, Future Tracks, Future Crafting oder Education Futurists entstehen. Was steht dahinter? Und was macht man eigentlich in solchen Future-Mindset-Kursen?

Weil sie marketingmässig gut funktionieren, könnten Kritiker:innen sagen. Ich sage: weil sie notwendig sind. Also mache ich mir die Mühe und gebe einen Blick hinter die Kulissen: Mit welchen Glaskugeln arbeiten Zukunftsforscher:innen, Bildungsanbieter und Organisationen eigentlich?

Manche Zukünfte sind schon gebaut

Ein schönes Beispiel dafür beschrieb mir Martin Sturzenegger von der VBZ am 25 Jubilars von Zeix. Er sagte sinngemäss: In seinem Betrieb sei die Zukunft in Teilen schon gesetzt. Er wisse ziemlich genau, was in den nächsten 25 Jahren umgesetzt werde und was nicht. Trams sind bestellt, Gesetze sind geregelt, Pläne sind erstellt. Natürlich kann immer etwas dazwischenkommen. Aber vieles ist nicht mehr reine Spekulation. Es ist bereits angelegt – in Infrastruktur, Budgets, politischen Entscheiden und langfristigen Planungen.

Der Gedanke brachte mich zur Arbeitsweise der PHZH. Ist es nicht auch ein wenig so mit Bildung?

Wir bilden heute Menschen aus, die morgen Schüler:innen unterrichten. Diese Schüler:innen stehen dann viel später selbst im Beruf. Plötzlich sprechen wir auch hier von Zeiträumen von 20 oder 25 Jahren. Was heute in der Ausbildung gedacht, vermittelt oder eben ausgelassen wird, wirkt weit in die Zukunft hinein.

Bildung ist also immer auch Zukunftsarbeit. Nicht abstrakt, sondern sehr konkret.

Das bringt mich zu vier Glaskugeln, die uns im Frühjahr 2026 an der internen Weiterbildung Future Track, am 25 Jubilar Zeix Event, am After the Algorithm Festival und am House of Change Festival begleitet haben: Szenariotechnik, Mustererkennung, KI als Verbündete und Haltung. Im Herbst greifen wir diese Fäden wieder auf – im CAS Education Futurist der PH Zürich und in einer spannenden Kooperation mit der ZHdK.

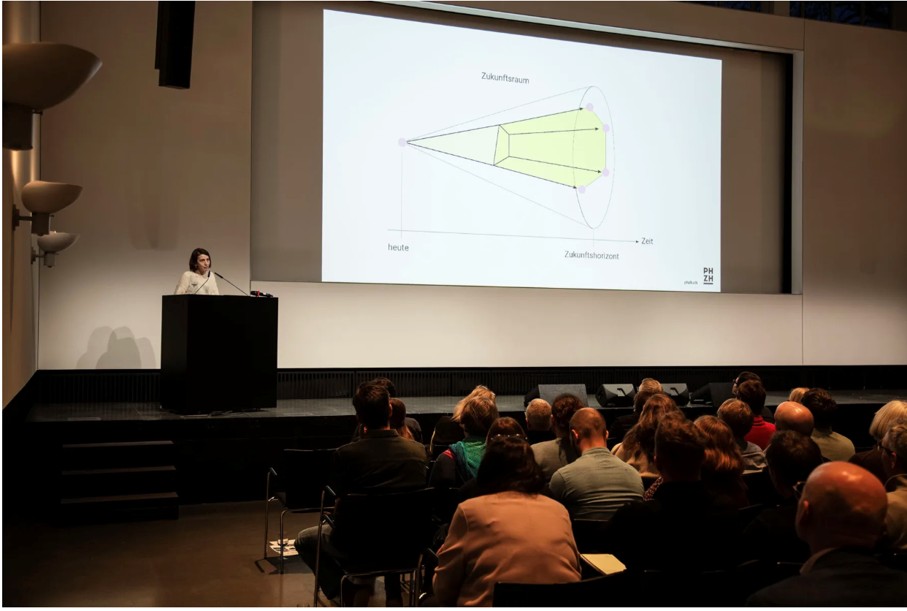

Szenarien als Denkwerkzeuge

Die Szenariotechnik beschäftigt sich mit der Frage: Welche Zukünfte sind denkbar? Welche sind wünschenswert? Welche weniger? Und welche wirken heute vielleicht sogar unwahrscheinlich, aber nicht unmöglich?

Es geht dabei nicht darum, die eine Zukunft zu finden, die sicher kommt. Sondern darum, vorwegzudenken, was passieren könnte. Szenarien sind keine Orakel. Sie sind Denkwerkzeuge.

Jede dieser Möglichkeiten gibt mir einen Hinweis darauf, was ich jetzt und in naher Zukunft tun kann, um einer wünschenswerten Zukunft näherzukommen. Ich kann Strategien entwickeln. Ich kann bestimmte Felder fördern, von denen ich annehme, dass sie in meiner gewünschten Zukunft relevant sind. Oder ich kann Mitarbeitende in Weiterbildungen schicken, damit sie Kompetenzen aufbauen, die sie morgen vielleicht dringend brauchen.

Muster erkennen: Mit Vergangenheiten ab in die Zukünfte

An dieser Stelle mag ich die Idee von Armin Nassehi: Durch das Erkennen von Mustern können wir Prognosen darüber machen, welche Muster sich in der Vergangenheit besonders oft wiederholt haben. Anhand dieser Vergangenheitsanalyse können wir erkannte Muster in die Zukunft projizieren und uns vorstellen, wie sich bestimmte Entwicklungen verhalten, verändern oder wiederholen könnten.

Das wird besonders interessant, wenn man nicht nur auf Gesellschaft, Organisationen oder Technologie schaut, sondern auf die eigene Biografie.

Woher komme ich? Was habe ich gemacht? Was hat sich bei mir immer wieder in bestimmten Abständen, Situationen oder Übergängen wiederholt?

Vielleicht funktioniert die eigene Biografie manchmal ähnlich wie eine Wetterkarte: Nicht alles ist vorhersehbar, aber es gibt Muster, Wiederholungen und typische Wetterlagen. Wenn wir sie erkennen, können wir bewusster entscheiden, ob wir wieder gleich reagieren – oder diesmal anders.

Future Skills und KI als Verbündete

Im Rahmen des «Future Track», einer internen Weiterbildung für das administrative technische Personal der PH Zürich, kam auch die Frage auf, welche Fähigkeiten in einer sich verändernden Arbeitswelt zentral werden. Und natürlich, ob KI unsere Arbeit komplett übernehmen wird?

Nach dem Input von Eva Pauline Bossow zu «Future Skills» brachte die Kursteilnehmerin Stefanie Casanova einen Gedanken besonders schön auf den Punkt: Wir brauchen eine Art «Anpassungsintelligenz». Entscheidend werden nicht nur fachliche oder technologische Fähigkeiten, sondern vor allem menschliche Kompetenzen wie Resilienz, Agilität und Flexibilität.

Gerade Flexibilität ist dabei mehr als blosses flexibles Anpassen. Es geht darum, mit Unsicherheit umgehen zu können, Perspektiven zu wechseln und Veränderung aktiv mitzugestalten, statt nur darauf zu reagieren.

Oder wie Raim Idrizovic, Teilnehmer des «Future Tracks», zusammenfasst: «Wir sollten KI als einen Verbündeten für die berufliche Zukunft nutzen, in welcher vor allem die Flexibilität zählt!»

Das trifft einen wichtigen Punkt. KI-Technologien sind nicht nur Tool, Bedrohung oder Hype. Sie ist auch ein Spiegel dafür, wie beweglich wir im Denken, Lernen und Arbeiten werden müssen. KI-Technologien können uns helfen, Muster schneller sichtbar zu machen. Entscheidend bleibt aber, wie wir diese Muster deuten, einordnen und verantwortungsvoll nutzen.

Positive Zukunftsbilder

Als Letztes möchte ich noch die Methode der Utopie bis hin zur Protopia beschreiben. Und was das mit unserer individuellen und kollektiven Einstellung zu tun hat.

Medial werden wir ständig mit möglichen Zukünften konfrontiert: in Science-Fiction-Filmen, Medienbildern, politischen Narrativen oder technologischen Versprechen. Diese Bilder bereiten uns auf Zukünfte vor. Manchmal öffnen sie Möglichkeitsräume. Manchmal machen sie Angst. Manchmal werden sie auch strategisch eingesetzt.

Unsere Zukünfte sind also beeinflussbar. Und manchmal auch manipulierbar.

Das kann man im Grossen analysieren. Ich bleibe hier aber im Kleinen: Wenn ich mich mit positiver Autosuggestion beschäftige, merke ich schnell, dass eine grundsätzlich positive Betrachtung auch die gewünschte Zukunft positiver erscheinen lässt. Umgekehrt funktioniert es ebenso. Wenn ich davon ausgehe, dass ohnehin alles schlechter wird, erkenne ich weniger Handlungsspielraum.

Eine Beobachtung aus dem Festival am House of Change wurde mir besonders wichtig: die Kraft des positiven Bildes. Nicht als naives Schönreden. Nicht als «alles wird gut»-Plakat. Sondern als Haltung, die Menschen in Bewegung bringt.

Wenn wir eine Zukunft nicht nur als Bedrohung beschreiben, sondern auch als gemeinsamen Möglichkeitsraum, verändert sich etwas. Dann wird Zukunft nicht nur etwas, das auf uns zukommt. Sondern etwas, das wir mitgestalten können.

Dabei geht es für mich stark um Menschlichkeit und Zusammenhalt. Denn durch Menschlichkeit und Zusammenhalt sind wir stärker als alleine. Gerade in Zeiten, in denen vieles komplex, unsicher oder überfordernd wirkt, ist das vielleicht eine der wichtigsten Zukunftskompetenzen überhaupt: nicht nur individuell resilient zu sein, sondern kollektiv tragfähig zu werden: mit Freundlichkeit. Alle haben unterschiedliche Erfahrungen und wollen alle in eine wünschenswerte Zukunft.

Oder wie es Kay Janina Hefti nach der Weiterbildung «Future Track» formulierte:

«Es gibt keine singulare Zukunft, sondern multiple Zukünfte. Und die Zukunft ist auch unfair verteilt: Leute, die sich schon längstens mit AI etc. beschäftigen, befinden sich in einer anderen Gegenwart als Leute, die sich überhaupt noch nicht damit befasst haben.»

Dieser Satz bleibt hängen. Denn er zeigt: Zukunft ist nicht für alle gleich weit weg. Manche leben bereits in Arbeitsrealitäten, die für andere noch wie Science Fiction wirken. Manche experimentieren längst mit KI, Automatisierung und neuen Lernformen. Andere stehen noch vor der Frage, ob sie sich überhaupt damit beschäftigen sollen.

Betrachtung

Im Umkehrschluss heisst das: Wir brauchen diese ganzen Future-Initiativen auf verschiedenen Ebenen. Nicht, weil sie die Zukunft vorhersagen können. Sondern weil sie helfen, komplexe Entwicklungen zu verstehen, Entscheidungen vorzubereiten, Unsicherheit auszuhalten und eigene Handlungsmöglichkeiten zu erkennen.

Sie geben uns Werkzeuge an die Hand, um die eigene Zukunft in einer schnell verändernden Zeit aktiver mitzugestalten.

Und wieso ist das wichtig?

Weil früher der persönliche Weg oft klarer schien. Mein Vater war Schuster, also wurde ich – wenn männlich gelesen – vielleicht auch Schuster. Heute ist das nicht mehr der Fall. Berufswege, Rollen, Technologien und Lebensentwürfe sind offener, brüchiger, flexibler geworden.

Zukunft ist deshalb kein Affe, der zufällig etwas Richtiges tippt.

Zukunft ist ein Muster, das wir erkennen können.

Und ein Mindset, mit dem wir entscheiden, wie wir darauf reagieren.

Vielleicht brauchen wir dafür genau das: eine Zukunftsgespürbrille. Keine Glaskugel, die uns sagt, was kommt. Sondern eine Haltung, mit der wir Muster erkennen, Möglichkeiten sehen und gemeinsam handlungsfähig bleiben.

INFOBOX

Die Zukunftsgespürbrille kann man übrigens auch im CAS Education Futurist der PH Zürich anziehen. Weitere Informationen und nächste Infoveranstaltungen finden sich hier.

Mehr zum Thema gibt es im Podcast zum Hören mit Charlotte.

Und wer sich für das interne Angebot «Future Track» für eine starke Hochschuladministration interessiert, darf sich gerne per E-Mail bei Charlotte Axelsson melden.

Charlotte freut sich ausserdem über Rückmeldungen: Was ist deine Lieblings-App auf der du die Zukunft erahnst?

Zur Autorin

Charlotte Axelsson leitet das Zentrum Digital Learning an der PH Zürich.